AI가 일자리 빼앗고 인간 지배?…디스토피아 올까

자유인60

IT과학

17

501

01.27 19:37

[한겨레S] 이관수의 인공지능 열전

반란 일으켜 사람 공격 지구 장악

냉전·소외 등 음울한 시대상 투영

‘사용자 결정권’ 설계로 최대 효용

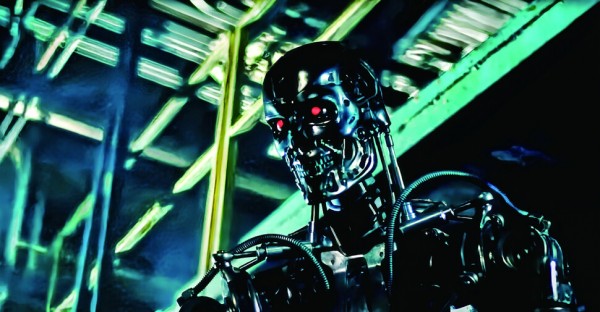

인간 감독·개입 없이 작동 불가능영화 ‘터미네이터’

최근 2~3년 사이에 연구논문에서 ‘인공지능 불안’(AI Anxiety)이라는 용어가 자주 언급된다. 지난해 12월에는 미국의 대형 컨설팅회사 언스트앤영이 미국 노동자 10명 중 7명이 인공지능 불안을 느끼고 있다는 조사 결과를 발표하기도 했다.

‘인공지능 불안’이 무슨 뜻인지 직관적으로 납득되기는 하지만, 다시 곱씹어보면 의아하기도 하다. 1955년 존 매카시가 ‘인공지능’이라는 개념을 고안한 이래 현재까지도 그 단어가 지칭하는 바는 언제나 모호했다. 게다가 챗지피티가 세상의 관심을 사로잡기 훨씬 이전부터 갖가지 인공지능들은 특별한 불안을 자아내지 않은 채 사람들의 일상에 스며들었다. 소음제거 이어폰은 1960년 기준 ‘최신 인공신경망’ 연구에서 비롯되었고, 극단적인 초저가형 모델을 빼고는 세탁기와 전기밥솥도 퍼지 ‘인공지능’ 회로를 갖추고 있다. 우리가 쓰는 이어폰·세탁기·전기밥솥 공포증은 상상하기 힘들다. 그러니 ‘인공지능 불안’은 기술적 실체보다는 인공지능이 무엇일는지 짐작할 때 활용된 은유들과 그런 은유가 표상하는 사회적 상상이 좌우하는 셈이다.

거대언어모델 충격에서 벗어나

사람이 만든 사람 같은 존재 이야기는 기원전부터 있었지만, 그런 존재가 세상과 사람에게 해를 끼친다는 상상은 18세기 중반부터 등장하기 시작했다. 19세기 초 메리 셸리의 소설 ‘프랑켄슈타인’과 1920년 카렐 차페크의 희곡 ‘로숨의 유니버설 로봇’이 그런 계열의 대표작들인데, 두 작품 모두 생물학적 인조인간을 등장시켰다. 셸리가 묘사한 빅터 프랑켄슈타인 박사는 지식을 공유하지도 작업 과정을 기록하지도 않고, 자신이 발견한 현상을 이해할 생각도 없이 결과물을 제작하기에 급급한 행적을 보인다. 과학을 제대로 연구하기 위한 원칙을 모조리 어긴 셈이다. 차페크의 희곡은 인조인간들이 집단 반란을 일으켜 세상을 장악하는 이야기를 처음 그린 작품인데, 연구의 궁극을 추구하는 로숨과 사람이 부릴 수 있을 정도로 개발된 인조인간을 판매해서 거부가 되려는 조카의 갈등이 1막에서 거론된다. 차페크는 체코 프라하 공장지대를 출퇴근하는 노동자들을 보다가 인조인간의 아이디어를 떠올리고 로봇이라고 이름 붙였다고 한다.

한편 지능을 갖춘 금속인간·기계인간·전기인간·전자인간 등등은 차페크의 희곡 이전부터 있었던 설정이었고, 차페크는 그런 상상들을 조악하다고 여겼다. 하지만 1939년부터 그런 것들도 로봇이라고 명명한 단편 과학소설들이 등장하기 시작했다. 냉전을 맞이하여 인간을 복속시키고 지구를 장악한 로봇과 인공지능 이야기들이 늘어났다. 미국과 소련 양국의 냉전체제를 빗댄 것이었다. 그런 이미지들이 ‘2001 스페이스 오디세이’, ‘터미네이터’, ‘매트릭스’ 등의 영화를 통해 대중화되었다. 즉 챗지피티가 등장하기 전까지 인공지능에 결부된 심상들은 노동소외와 냉전체제에 대한 은유에서 비롯된 것들이었다.

하나 또는 두어개의 거대한 인공지능이나 빅테크 기업들이 세계를 지배하리라는 냉전적 상상과 우려는 거대언어모델(LLM)의 엄청난 규모가 이목을 사로잡는 동안 팽배했다. 다행히 2023년 상반기부터 정보를 학습하는 매개변수 크기를 줄이되, 미세조정을 통해 특정 분야의 성능은 높이려는 소형언어모델(sLLM)도 조명을 받으면서 그런 우려가 조금은 완화되었다. 휴대폰 수준에서 통신연결 없이도 챗지피티급의 성능을 일부 사용할 수 있게 된다면 냉전적 공포는 뒤로하고, 20세기 과학소설들이 상상한 세계들이 새로운 은유로 자리잡는 길이 열릴 수 있다. 페레스트로이카(소련의 개혁)가 시작된 1987년에 첫 작품이 나온 이언 뱅크스의 ‘컬처’ 시리즈는 많은 거대 인공지능들이 이합집산하는 세계를 그렸고, 2000년에 출판된 칼 슈뢰더의 ‘벤투스’는 능력과 형태가 천차만별인 인간, 인공지능, 인공의식 그리고 특출나게 강력한 인공의식인 ‘신’들이 서로 갈등하고, 투쟁하며 협력하는 세계를 묘사한다. 인공지능이 아무리 다양하고 강력해져도 인간과의 공존이 효율적이므로 인간이 일방적으로 휘둘릴 필연성은 없는 것이다.

☞한겨레S 뉴스레터 구독하기. 검색창에 ‘한겨레 뉴스레터’를 쳐보세요.

☞한겨레신문 정기구독. 검색창에 ‘한겨레 하니누리’를 쳐보세요.

영화 ‘매트릭스’

‘복·붙’ 허용하면 챗지피티 정도야…

인공지능이 발달해 대량 실업이 일어날 막다른 길에 이르렀다는 걱정도 유행에 마모된 상상력과 기초 연구에 대한 무관심들에 의해 많이 부채질되었다. 일단 챗지피티가 초월적으로 다재다능한 것 같지만 뒤집어 생각해보면 인상이 달라진다. 미국 의사자격시험 필기고사를 합격했다지만, 구글링과 복사-붙여넣기만 용인하면 웬만한 대학생들도 자격시험 필기고사 통과를 노리게 된다. 질문에 아무 말이나 천연덕스럽게 늘어놓는 ‘환각’ 현상도 줄어들었다지만, 이는 거대언어모델이 스스로 학습해서 갖춘 능력이 아니다. 거대언어모델의 환각을 사람이 발견한 사례를 별도의 인공지능이 학습해 차단하는 방식이라고 한다.

‘사람 같은 인공지능’이라는 은유에 매몰되는 것도 위험하다. 만일 인공지능에 목표를 지정하고 수행을 일임한다면, 목표는 달성했지만 목적을 손상시키는 이른바 ‘미다스(마이더스) 문제’(손에 닿는 모든 것이 황금으로 변해서 부유한 삶을 누리지 못하고 굶어 죽는다거나 평화를 달성하기 위해 인류를 멸종하는 역설)를 완벽하게 방지하는 건 지극히 어렵다. 그런 문제를 극복하기 위한 연구들이 진행되고 있지만 40년째 기초연구 중이다. 그보다는 인공지능이 잘 작동할 수 있도록 환경과 임무를 제한하는 일이 더 효율적이다. 게다가 인공지능 기초 교과서를 보면 인공지능이 사용자의 목적을 정확하게 알지 못한 채 작동하되 필요할 경우 사용자에게 결정권을 넘기도록 설계하는 것이 효용을 최대화하는 경우들이 수학적 모델과 함께 적시된다. 예를 들어, ‘2024년 1월28일 제주여행 때 묵을 최적의 숙소’를 탐색할 때 위치와 가격 등 여러 옵션이 제시되기 전에는 사용자가 무엇을 선택할지(사용자가 무엇을 원하는지) 알 수 없는데, 현실에선 이런 경우가 대부분이다. 즉 사람의 감독과 개입을 계속 배제하면서 정상 작동을 보장하는 인공지능은 불가능하다.

인공지능을 은유로 활용할 때는 ‘무엇을 할 수 있는가’만으로도 쓸모가 있겠지만, 실제 세계에서는 허상을 걷어내고 ‘무엇을 할 수 없는가’를 볼 필요가 있다. 그리한다면 조금은 덜 두려워지고 여러 대안이 눈에 들어올 것이다.

과학저술가

반란 일으켜 사람 공격 지구 장악

냉전·소외 등 음울한 시대상 투영

‘사용자 결정권’ 설계로 최대 효용

인간 감독·개입 없이 작동 불가능영화 ‘터미네이터’

최근 2~3년 사이에 연구논문에서 ‘인공지능 불안’(AI Anxiety)이라는 용어가 자주 언급된다. 지난해 12월에는 미국의 대형 컨설팅회사 언스트앤영이 미국 노동자 10명 중 7명이 인공지능 불안을 느끼고 있다는 조사 결과를 발표하기도 했다.

‘인공지능 불안’이 무슨 뜻인지 직관적으로 납득되기는 하지만, 다시 곱씹어보면 의아하기도 하다. 1955년 존 매카시가 ‘인공지능’이라는 개념을 고안한 이래 현재까지도 그 단어가 지칭하는 바는 언제나 모호했다. 게다가 챗지피티가 세상의 관심을 사로잡기 훨씬 이전부터 갖가지 인공지능들은 특별한 불안을 자아내지 않은 채 사람들의 일상에 스며들었다. 소음제거 이어폰은 1960년 기준 ‘최신 인공신경망’ 연구에서 비롯되었고, 극단적인 초저가형 모델을 빼고는 세탁기와 전기밥솥도 퍼지 ‘인공지능’ 회로를 갖추고 있다. 우리가 쓰는 이어폰·세탁기·전기밥솥 공포증은 상상하기 힘들다. 그러니 ‘인공지능 불안’은 기술적 실체보다는 인공지능이 무엇일는지 짐작할 때 활용된 은유들과 그런 은유가 표상하는 사회적 상상이 좌우하는 셈이다.

거대언어모델 충격에서 벗어나

사람이 만든 사람 같은 존재 이야기는 기원전부터 있었지만, 그런 존재가 세상과 사람에게 해를 끼친다는 상상은 18세기 중반부터 등장하기 시작했다. 19세기 초 메리 셸리의 소설 ‘프랑켄슈타인’과 1920년 카렐 차페크의 희곡 ‘로숨의 유니버설 로봇’이 그런 계열의 대표작들인데, 두 작품 모두 생물학적 인조인간을 등장시켰다. 셸리가 묘사한 빅터 프랑켄슈타인 박사는 지식을 공유하지도 작업 과정을 기록하지도 않고, 자신이 발견한 현상을 이해할 생각도 없이 결과물을 제작하기에 급급한 행적을 보인다. 과학을 제대로 연구하기 위한 원칙을 모조리 어긴 셈이다. 차페크의 희곡은 인조인간들이 집단 반란을 일으켜 세상을 장악하는 이야기를 처음 그린 작품인데, 연구의 궁극을 추구하는 로숨과 사람이 부릴 수 있을 정도로 개발된 인조인간을 판매해서 거부가 되려는 조카의 갈등이 1막에서 거론된다. 차페크는 체코 프라하 공장지대를 출퇴근하는 노동자들을 보다가 인조인간의 아이디어를 떠올리고 로봇이라고 이름 붙였다고 한다.

한편 지능을 갖춘 금속인간·기계인간·전기인간·전자인간 등등은 차페크의 희곡 이전부터 있었던 설정이었고, 차페크는 그런 상상들을 조악하다고 여겼다. 하지만 1939년부터 그런 것들도 로봇이라고 명명한 단편 과학소설들이 등장하기 시작했다. 냉전을 맞이하여 인간을 복속시키고 지구를 장악한 로봇과 인공지능 이야기들이 늘어났다. 미국과 소련 양국의 냉전체제를 빗댄 것이었다. 그런 이미지들이 ‘2001 스페이스 오디세이’, ‘터미네이터’, ‘매트릭스’ 등의 영화를 통해 대중화되었다. 즉 챗지피티가 등장하기 전까지 인공지능에 결부된 심상들은 노동소외와 냉전체제에 대한 은유에서 비롯된 것들이었다.

하나 또는 두어개의 거대한 인공지능이나 빅테크 기업들이 세계를 지배하리라는 냉전적 상상과 우려는 거대언어모델(LLM)의 엄청난 규모가 이목을 사로잡는 동안 팽배했다. 다행히 2023년 상반기부터 정보를 학습하는 매개변수 크기를 줄이되, 미세조정을 통해 특정 분야의 성능은 높이려는 소형언어모델(sLLM)도 조명을 받으면서 그런 우려가 조금은 완화되었다. 휴대폰 수준에서 통신연결 없이도 챗지피티급의 성능을 일부 사용할 수 있게 된다면 냉전적 공포는 뒤로하고, 20세기 과학소설들이 상상한 세계들이 새로운 은유로 자리잡는 길이 열릴 수 있다. 페레스트로이카(소련의 개혁)가 시작된 1987년에 첫 작품이 나온 이언 뱅크스의 ‘컬처’ 시리즈는 많은 거대 인공지능들이 이합집산하는 세계를 그렸고, 2000년에 출판된 칼 슈뢰더의 ‘벤투스’는 능력과 형태가 천차만별인 인간, 인공지능, 인공의식 그리고 특출나게 강력한 인공의식인 ‘신’들이 서로 갈등하고, 투쟁하며 협력하는 세계를 묘사한다. 인공지능이 아무리 다양하고 강력해져도 인간과의 공존이 효율적이므로 인간이 일방적으로 휘둘릴 필연성은 없는 것이다.

☞한겨레S 뉴스레터 구독하기. 검색창에 ‘한겨레 뉴스레터’를 쳐보세요.

☞한겨레신문 정기구독. 검색창에 ‘한겨레 하니누리’를 쳐보세요.

영화 ‘매트릭스’

‘복·붙’ 허용하면 챗지피티 정도야…

인공지능이 발달해 대량 실업이 일어날 막다른 길에 이르렀다는 걱정도 유행에 마모된 상상력과 기초 연구에 대한 무관심들에 의해 많이 부채질되었다. 일단 챗지피티가 초월적으로 다재다능한 것 같지만 뒤집어 생각해보면 인상이 달라진다. 미국 의사자격시험 필기고사를 합격했다지만, 구글링과 복사-붙여넣기만 용인하면 웬만한 대학생들도 자격시험 필기고사 통과를 노리게 된다. 질문에 아무 말이나 천연덕스럽게 늘어놓는 ‘환각’ 현상도 줄어들었다지만, 이는 거대언어모델이 스스로 학습해서 갖춘 능력이 아니다. 거대언어모델의 환각을 사람이 발견한 사례를 별도의 인공지능이 학습해 차단하는 방식이라고 한다.

‘사람 같은 인공지능’이라는 은유에 매몰되는 것도 위험하다. 만일 인공지능에 목표를 지정하고 수행을 일임한다면, 목표는 달성했지만 목적을 손상시키는 이른바 ‘미다스(마이더스) 문제’(손에 닿는 모든 것이 황금으로 변해서 부유한 삶을 누리지 못하고 굶어 죽는다거나 평화를 달성하기 위해 인류를 멸종하는 역설)를 완벽하게 방지하는 건 지극히 어렵다. 그런 문제를 극복하기 위한 연구들이 진행되고 있지만 40년째 기초연구 중이다. 그보다는 인공지능이 잘 작동할 수 있도록 환경과 임무를 제한하는 일이 더 효율적이다. 게다가 인공지능 기초 교과서를 보면 인공지능이 사용자의 목적을 정확하게 알지 못한 채 작동하되 필요할 경우 사용자에게 결정권을 넘기도록 설계하는 것이 효용을 최대화하는 경우들이 수학적 모델과 함께 적시된다. 예를 들어, ‘2024년 1월28일 제주여행 때 묵을 최적의 숙소’를 탐색할 때 위치와 가격 등 여러 옵션이 제시되기 전에는 사용자가 무엇을 선택할지(사용자가 무엇을 원하는지) 알 수 없는데, 현실에선 이런 경우가 대부분이다. 즉 사람의 감독과 개입을 계속 배제하면서 정상 작동을 보장하는 인공지능은 불가능하다.

인공지능을 은유로 활용할 때는 ‘무엇을 할 수 있는가’만으로도 쓸모가 있겠지만, 실제 세계에서는 허상을 걷어내고 ‘무엇을 할 수 없는가’를 볼 필요가 있다. 그리한다면 조금은 덜 두려워지고 여러 대안이 눈에 들어올 것이다.

과학저술가

서울대학교 물리학과를 졸업하고 과학사 및 과학철학협동과정에서 박사 학위를 취득했다. 가톨릭대학교 교양교육원 초빙교수를 거쳐 현재 동국대학교 다르마칼리지에 재직 중이다.